Amazon Web Services(AWS)與 AI 晶片公司 Cerebras Systems 宣布合作,將推出針對生成式 AI 與大型語言模型工作負載的高速推論解決方案。該方案將部署於 AWS 資料中心的 Amazon Bedrock 平台,結合 AWS 自研 AI 晶片 Trainium 與 Cerebras CS-3 系統,目標大幅提升 AI 推論速度。

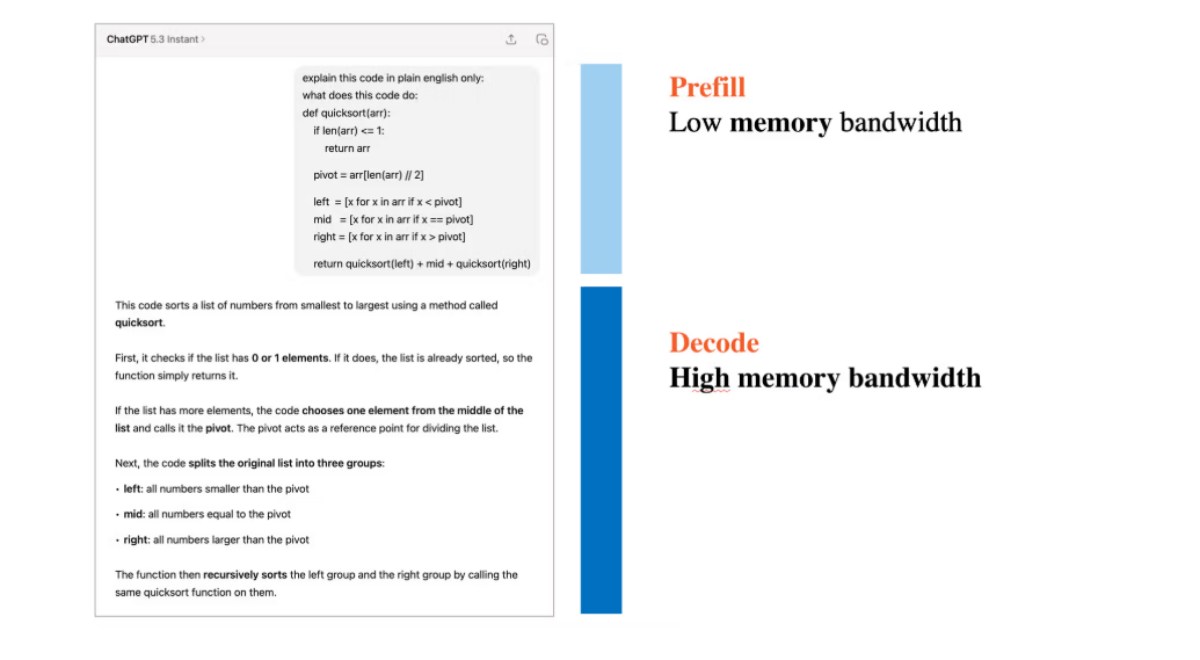

AWS 表示,此次合作採用「推論分離(Inference Disaggregation)」架構,將 AI 推論流程拆分為兩個階段:提示處理(prefill)與輸出生成(decode)。其中 prefill 主要負責處理使用者輸入提示,具有高度平行運算特性,計算需求較高;而 decode 則負責逐步生成輸出內容,必須以序列方式產生 token,通常占據推論過程的大部分時間,需要較大量記憶體頻寬。

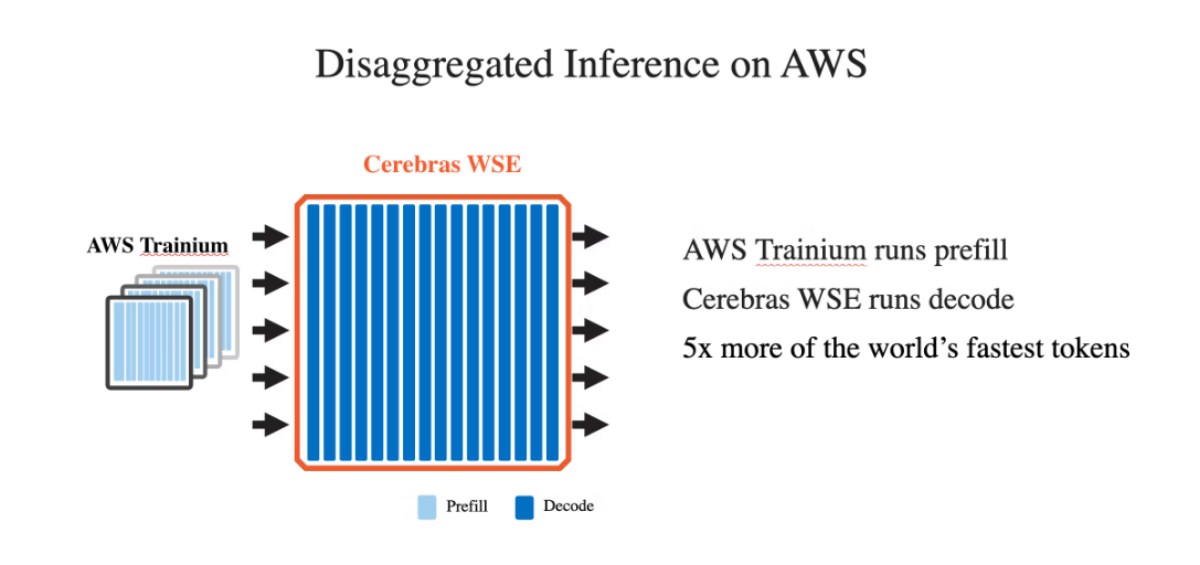

在此次架構中,AWS Trainium 將主要負責 prefill 階段,而 Cerebras CS-3 則專門負責 decode 運算,兩者透過 Elastic Fabric Adapter(EFA)高速網路連接,使不同處理器能針對各自擅長的運算任務進行最佳化。AWS 指出,透過這種分工方式,整體推論效能可望較現有方案提升一個數量級。

Trainium 為 AWS 自行設計的 AI 晶片,主要用於生成式 AI 訓練與推論,目前包括 Anthropic 與 OpenAI 等 AI 公司皆已採用相關基礎設施。其中 Anthropic 已將 AWS 做為主要模型訓練平台,而 OpenAI 也計劃透過 AWS 使用大規模 Trainium 運算資源。

另一方面,Cerebras 的 CS-3 系統則以高記憶體頻寬著稱,號稱其頻寬可達目前最快 GPU 的數千倍,適合用於加速推論過程中的 decode 階段。

隨著推理型 AI 模型逐漸普及,模型在推論時需要生成更多 token,推論速度也成為 AI 應用的重要瓶頸。Cerebras 表示,目前已有 OpenAI、Cognition 與 Mistral 等公司使用其系統加速 AI 工作負載。

(圖片來源:Cerebras)