根據 3 月 24 日發表於北美放射學會(RSNA)旗艦期刊《放射學》(Radiology)的一項最新研究,人工智慧(AI)生成的「深偽」(Deepfake)X 光片已達到足以亂真的程度,不僅能欺騙資深的放射科醫師,連最先進的多模態大型語言模型(LLM)也難以準確辨識。這項發現引發了醫學界對醫療紀錄真實性及網路安全風險的嚴肅討論。

這項研究由紐約西奈山伊坎醫學院的 Mickael Tordjman 博士領導,邀請了來自美國、法國、德國、土耳其、英國及阿拉伯聯合大公國等 6 個國家、12 個醫療中心的 17 位放射科醫師參與。受試者的資歷跨度極大,從新手到擁有 40 年經驗的專家皆有。研究團隊準備了 264 張 X 光片,其中一半為真實影像,另一半則是由 ChatGPT 或史丹佛大學開發的開源模型 RoentGen 所生成的合成影像。

研究結果顯示,當放射科醫師在不知情的情況下進行評估時,僅有 41% 的人能自主察覺影像異常。即便在被告知包含 AI 生成影像後,醫師的平均辨識準確率也僅提升至 75%,且表現差異極大,部分醫師的準確率低至 58%,最高則達 92%。令人驚訝的是,專業年資並未顯著提升辨識能力,僅有肌肉骨骼放射科醫師的表現略優於其他專科。

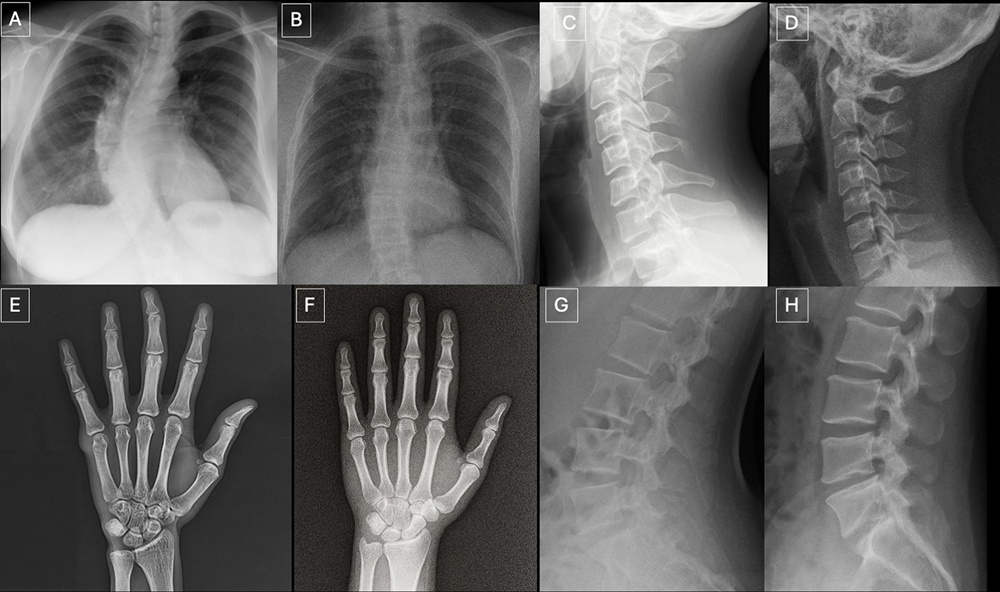

▲ 這些成對影像顯示,GPT-4o 能在不同解剖區域產生在放射學上看起來合理的影像。(A)真實與(B)GPT-4o 生成的胸腔 X 光片,(C)真實與(D)GPT-4o 生成的頸椎偏位 X 光片,(E)真實與(F)GPT-4o 生成的手部 X 光片,以及(G)真實與(H)GPT-4o 生成的腰椎偏位 X 光片。(Source:論文)

除了人類專家,AI 模型在偵測深偽影像上也面臨挑戰。研究測試了包括 GPT-4o、GPT-5、Gemini 2.5 Pro 以及 Meta 的 Llama 4 Maverick 在內的多款模型,其準確率介於 57% 至 85% 之間。諷刺的是,即便曾參與生成這些影像的 ChatGPT-4o,也無法完全辨識出所有的偽造作品。

Tordjman 博士指出,這些深偽影像之所以難以辨認,是因為它們往往看起來「太過完美」。例如,骨骼過於光滑、脊椎異常筆直、肺部過度對稱、血管模式過於均勻,或是骨折的裂痕過於乾淨且僅侷限於骨骼的一側。這種「完美」在現實的人體生理結構中極為罕見,卻成了 AI 繪圖的特徵。

專家警告,這項技術的成熟可能帶來嚴重的社會風險。深偽 X 光片可能被用於詐欺訴訟,或成為駭客攻擊醫院網路的手段,透過植入虛假影像來操縱診斷結果,進而破壞數位醫療紀錄的根本可信度。為了應對威脅,研究人員建議應加強數位防護措施,例如在醫療影像中嵌入不可見的浮水印,或使用與操作技術員關聯的加密簽章。

隨著 AI 技術持續演進,研究團隊預測下一步將出現 3D 醫療影像(如 CT 或 MRI)的深偽技術。目前,該團隊已釋出一套深偽影像數據集與互動式測驗,旨在提升醫療從業人員的警覺性與辨識能力,為未來的醫療影像安全保衛戰做準備。

- Even Doctors Can’t Tell These AI X-Rays Are Fake

- Can you spot a deepfake X-ray? Neither can your radiologist

- Deepfake X-Rays Fool Radiologists and AI

(首圖來源:Unsplash)