在 2025 年 OCP Global Summit 上,Meta 副總裁 Dan Rabinovitsj 表示,隨著人工智慧(AI)演算法與大型語言模型(LLM)快速演進,Meta 的基礎設施正全面升級,從單一 GPU 叢集擴展至跨多地區的超級資料中心,以支撐龐大的 AI 訓練需求。他指出,AI 的擴展需求遠超過原本的想像,也將推動整個基礎設施從設計、連線到能源配置需重新調整。

從單一叢集到跨區域超級運算

Rabinovitsj 表示,隨著 AI 模型規模與運算量急遽成長,Meta 已從早期的小型 GPU 叢集,逐步發展出能橫跨整座資料中心的訓練架構,並開始嘗試連結多個地區的資料中心,打造「跨區域 AI 叢集」。

他坦言,這樣的規模化不只是硬體升級,更牽涉到網路互連、散熱與能源管理等全方位挑戰,也象徵 AI 訓練正邁向真正的「全球級規模」。

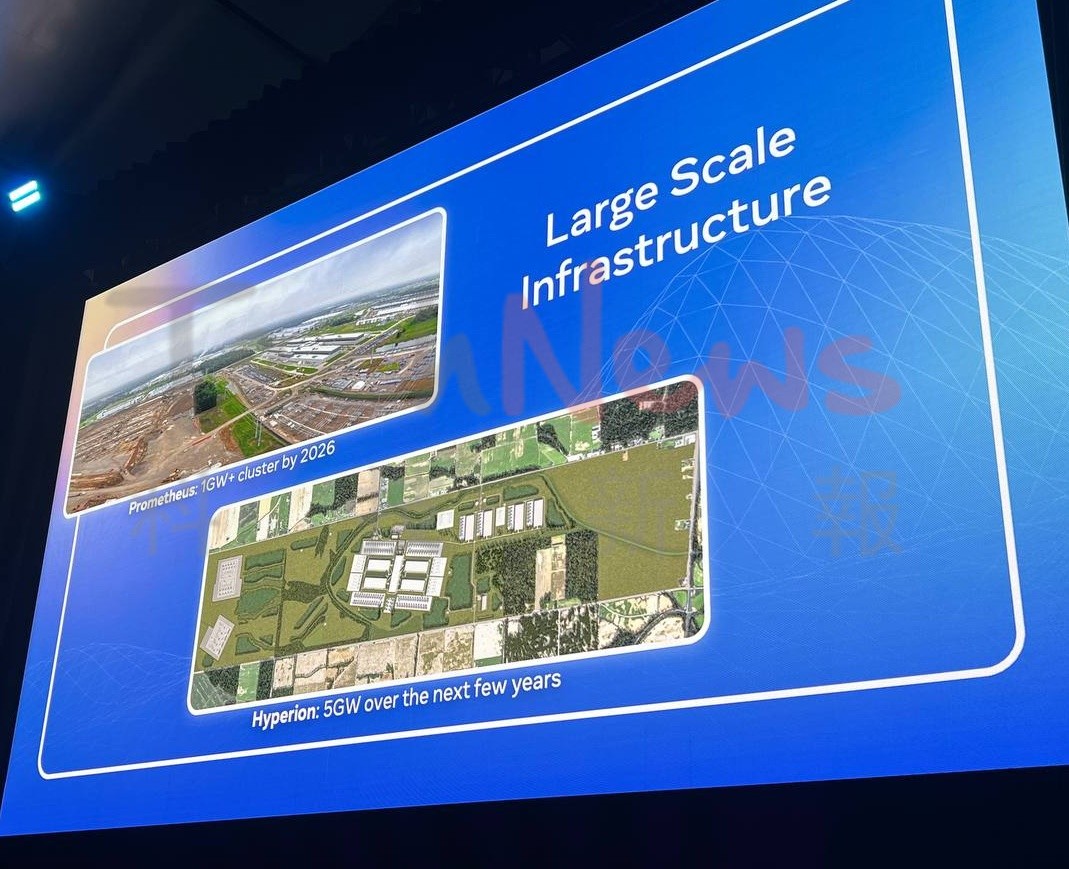

Meta 資料中心 New Albany 與 Hyperion

目前 Meta 正同步建設兩座超大型資料中心:位於俄亥俄州 New Albany 的 Prometheus 叢集已正式投入運作,總功率超過 1 GW;另一座位於路易斯安那州 Richland Parish 的 Hyperion 中心則規模達 5 GW,為全球最大單一 AI 資料中心之一。

Rabinovitsj 形容:「如果你從曼哈頓下城 14 街一路走到中央公園北端 110 街,走路大概需要三小時的距離,大約就是 Hyperion 的實際規模。」若以台灣為例,長度甚至比從內湖科學園區走到台北 101 還遠。這兩座資料中心將支撐未來世代的 Llama 模型與多區域 AI 訓練叢集,象徵 Meta 正正式邁入跨區域的超級運算時代。

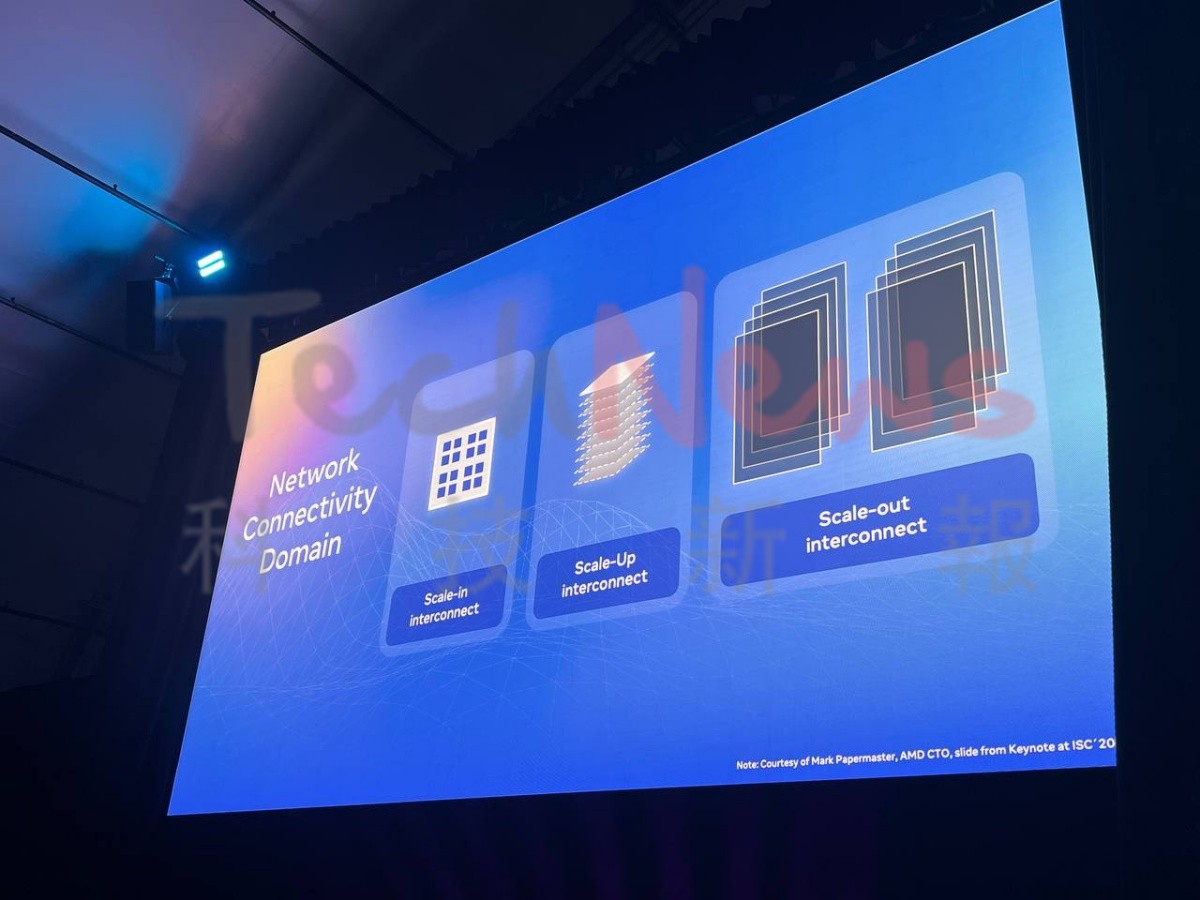

Scale-In、Scale-Up、Scale-Out 架構支撐超大規模 AI

隨著 AI 模型參數量持續倍增,Meta 採用三層級擴展架構──Scale-In(晶片內互連)、Scale-Up(叢集內互連)、Scale-Out(跨區域互連)。

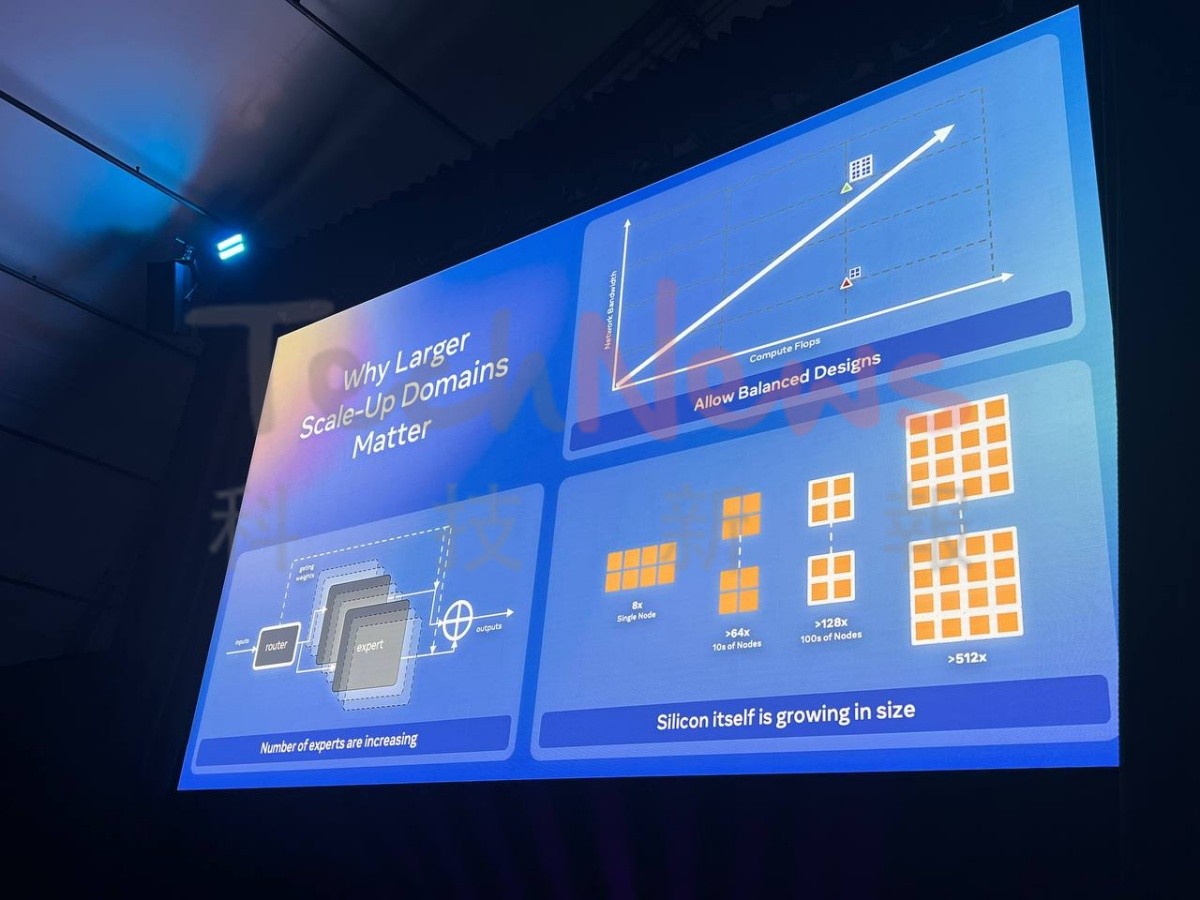

其中,Scale-Up 對 AI 效能愈發關鍵。Rabinovitsj 解釋,隨著晶片的運算密度與 FLOPS 急遽提升,若無法同時擴大網路與記憶體頻寬,就無法充分發揮運算能力;而 更大的 Scale-Up 網域 正能在同一高速互連環境中平衡這三者的性能。

他進一步指出,Mixture-of-Experts(混合專家模型) 的興起也是關鍵因素。此類模型由上百個 專家節點(experts) 所組成,每次運算僅啟用部分節點進行動態路由,因此需要極低延遲的通訊環境。

「這些專家必須共存在同一個 Scale-Up 網域中,才能維持訓練效率與穩定度」。

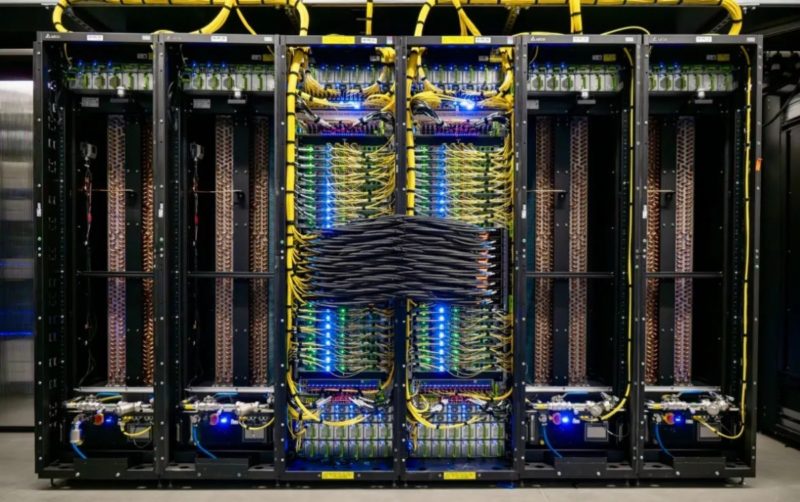

為了支撐這樣的高密度運算與低延遲互連需求,硬體層面的變革也勢在必行。「我們不得不打造越來越大的機架(rack),這已是整個產業的趨勢,」Rabinovitsj 表示。

液冷、光互連成趨勢,解構化減少能源浪費

然而,這種「瘋狂規模」的擴展也帶來前所未有的挑戰。Rabinovitsj 坦言,大型機架的設計與維運極為困難,僅移動一座機架的重量就相當於「一頭非洲象」。隨著功耗與熱密度攀升,液冷技術已成為不可逆的主流方向。

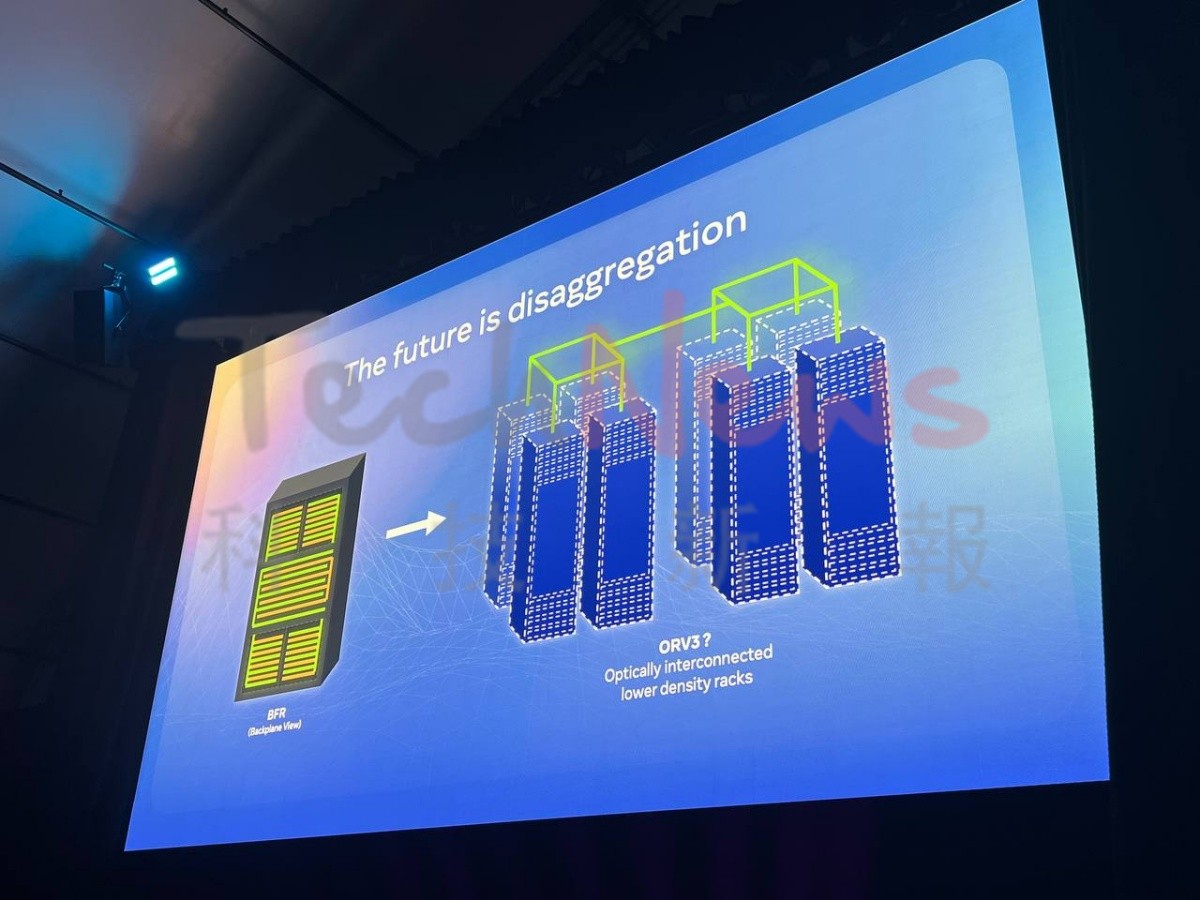

他指出,未來的關鍵將是 Optical Disaggregation:以光互連取代傳統銅線,讓電力分配更靈活、能有效降低能源浪費,同時提升資料中心電力使用效率(PUE)。這項轉變不僅能緩解電力壓力,也將為 AI 訓練叢集開啟更高密度與更長距離的互連設計空間。

電力與人才需求同步飆升,產業面臨三大壓力

隨著基礎設施規模持續放大,Rabinovitsj 指出,整個產業正同時面臨三大壓力:電力供應不足、工程人才短缺與製造產量不足。他透露,每交付 10 MW 的資料中心容量,代工廠就必須額外建置 1 MW 測試能量,「這是我們從未要求過的投資規模。」這代表供應鏈必須同步升級,才能支撐 AI 擴展的速度。

Rabinovitsj 指出,AI 正以驚人的速度改寫所有基礎設施規則。「我們以為已經懂得如何擴展資料中心,但事實上,AI 正讓我們重新學習。」

未來數年內,液冷、光互連與開放標準化 將是推動整個生態前進的三大關鍵,也可能催生全新的資料中心架構與技術模式。

(首圖來源:Meta)