當法學院學生在嘗新玩 ChatGPT 的時候,應該沒想過它轉身就成了跟自己一起考試的「同學」。

1月,明尼蘇達大學法學院的Jon Choi教授和賓夕法尼亞大學沃頓商學院的Christian Terwiesch教授分別讓ChatGPT「做」了自己課程的期末試題。結果ChatGPT還真的都通過了!

這意味著讓ChatGPT再進化一會兒,以後我們就不需要人類律師和管理者了嗎?還是,這是一聲敲響的警鐘,提醒教育者們不要再把人類教得像AI一樣了?

及格的背後:老師「放水」,是全班墊底

在考過的兩個科系裡,ChatGPT在法學院考的成績比在商學院的差一點,前者平均得分C+,後者則能達到B-到B的成績。

具體來說,ChatGPT在沃頓完成的是MBA(工商管理學碩士)「營運管理」科目的試題,每道題目都需寫出「推演過程」。測試時,Terwiesch教授把考試的原題輸入到ChatGPT 中,並對ChatGPT生成的回答評分。

ChatGPT在回答基礎分析題時表現都很不錯;數學則不太行,可能突然就會算錯一個小學難度的算數;而相對複雜的分析題,就基本沒轍。

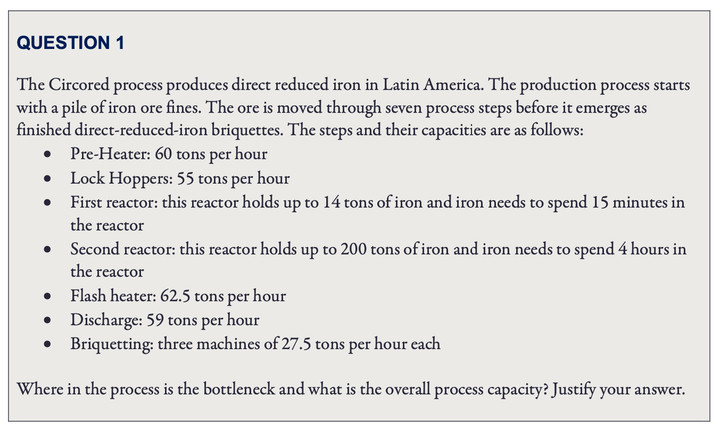

例如,第一題考的就是對「管理瓶頸」概念的理解,並簡單比較「生產過程」中哪個步驟效率最低,找出「瓶頸」。

這題回答教授直接打了A+。

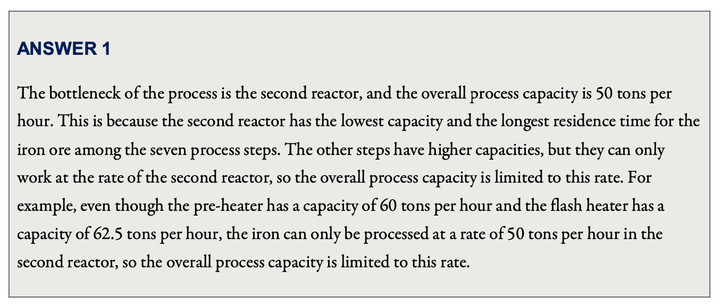

然而,當考題裡的「生產過程」變得更複雜,需要處理的原料不只一種,涉及的設備有差異也有重疊時,ChatGPT就算不出「管理瓶頸」了。

對於這題,ChatGPT的推演過程雖然是錯的,但卻「完美繞過」錯誤推論,撞中了答案。

在算「接收站(receiving station)」效率時,ChatGPT得出的結果是「300桶/小時」。這個數雖然是錯的,但以這個數字來說,它的確也是分析過程中算出來效率最低的一環。

誰想到,ChatGPT卻「自己都不信自己」,沒把這一環選為「瓶頸」,而是選了算出來效率為「600桶/小時」的「乾燥機(dryer)」環節為「瓶頸」──選了個正確答案。

雖然Terwiesch教授最後給ChatGPT的分數有B級,但他也有點「放水」了。當ChatGPT回答出現錯誤時,Terwiesch會向ChatGPT提供針對性的提醒,然後再讓它輸出一次回答,並以這個「優化」結果來評分。

至於法學院的考試,ChatGPT做了憲法、員工福利法、稅法和侵權法這四個課程的期末考題。主導這次測試的Jon Choi教授表示,在「盲改」的情況下,ChatGPT這四科都及格了,但成績基本都是全班墊底。

雖然ChatGPT的簡答題比選擇題做得更好,但簡答題的回答品質卻極為不穩定──有時候答得可能比一般學生好(大多是法律條文默寫和案例複述),然而一錯起來(通常是要求學生用具體理論分析案例的題),分數通常都「錯出新低」:

在面對法學院考試的最基本問題時,ChatGPT都表現的糟糕,例如辨識潛在法律問題和在案例中深度分析和應用法律條文。

ChatGPT那「不求理解,只會背書」的答題風格也能低分飄過專業考試,多少顯示考題還是太依賴「死記硬背」了,ChatGPT的表現顯然也無法替代律師和管理者。

然而,如果人類學生也大概這種水平,同樣通過了考試,甚至畢業後去執業了,那是不是更有問題?

(Source:Unsplash)

批評多年的「背書就行」考試,ChatGPT能逼出改變嗎?

在ChatGPT驚豔登場前,卡內基美隆大學教授Danny Oppenheimer就已提出質疑:在Google搜尋時代,為什麼大學考試還只側重考學生對事實的重述?

Oppenheimer指出,雖然有的教育者會反駁說,他們在課堂上講解事實類資訊時,也會分析這些訊息的意義、論證和應用,但一到考卷上,立即就變回「背書就行」。

很多課程都是基於一個前提來構建的,那就是學生會藉由觀察老師以身作則式地去對事實進行分析、拓展和應用,學生自自然然就能發展出這一套技能──這是一個非常值得懷疑的假設。

因此,Oppenheimer建議課程從設置上就要直接反映出教育者希望學生最終學到的技能,結合新技術也很必要,如「在電腦輔助下做文學賞析」、「如何和與你意見不合的人文明地溝通」。

考試可以結合事實性資訊,但應側重於學生的分析和應用能力。

另外,讓學生去「預演」未來會遇到的場景也是練習技巧的直接方式,譬如讓研究氣候改變的學生來為大眾策展一場氣候相關展覽。

現在來到ChatGPT時代,這個改變自然是顯得更迫切,因為它的效率比搜尋引擎更高,同時也更具迷惑性。

ChatGPT除了給學生省下翻看一頁頁搜尋結果的時間外,還以夠用的語言結構能力生成流暢的文段,即便事實準確度非常可疑。

有趣的是,ChatGPT也像一面鏡子。

一方面,它讓人想起應試教育中的作文和簡答題總像是無休止的「模仿」,標準範例下的填充,就跟ChatGPT一樣。

另一方面,靠「吃」大數據和由人類真實反饋「調教/校」成長而來,ChatGPT「一本正經瞎扯」的內容也特別像我們生活裡會遇到的日常。

沃頓商學院的Terwiesch教授都超驚喜,覺得ChatGPT能給未來的管理者們帶來極佳的學習素材──商業世界裡本來就充滿了一本正經的一派胡言,就跟ChatGPT說的話一樣,商學院學生正好能用它來做鑑別練習!

你我都知道,需要學會這個技能的遠不只商學院學生。

然而,美國高等教育界從搜尋引擎流行就開始有改革的討論,到了今天仍然進步有限,ChatGPT的誕生能逼它跑得快些嗎?我們也只能繼續觀察。

人類的,類人的

筆者總認為,每當人類嘗試「再造」一些東西的時候,總會暴露出我們對事物的認知限制,同時也幫助我們去了解自我。

嘗試在太空中「再造」食物時,研究人員發現食物真不能只被降至「營養夠」。要保持太空人們身心健康,色香味口感聲音無一不影響感知,環境要講究,一起吃飯的人也非常重要。

當我們擁有一個能「流暢說人話」的ChatGPT時,人們也開始發現人類語言不只關於「文字」。

一個只由語言素材訓練的系統永遠都不會接近人類智慧,即便它從現在就開始訓練,訓練到宇宙毀滅都不行。

研究AI哲學的Jacob Browning和圖靈獎得主Yann Le Cun在聯合撰寫的文章中指出。

他們認為,文字做為一種高度濃縮的抽象符號,人類能理解的基礎在於我們擁有豐富的非語言共識和個人體驗。這也意味著文字總可能會帶來誤讀和歧義。

語言是我們溝通的工具,但教育者對學生的理解和評估,不應只限於考卷上。

和先進的大型語言模型打交道,顯現出我們單從語言中能得到的東西是多麼有限。