高速運算需求成長,更有效的 AI 伺服器散熱方案也受重視。TrendForce 最新 AI 伺服器報告,NVIDIA 將在年底推出新平台 Blackwell,屆時大型 CSP 也會開始建置 Blackwell 新平台 AI 伺服器資料中心,有機會帶動液冷散熱方案滲透率達 10%。

氣冷、液冷並行方案滿足更高散熱需求

NVIDIA Blackwell平台2025年放量,取代Hopper平台成NVIDIA高階GPU主力方案,占整體高階產品近83%。B200和GB200等追求高效能的AI伺服器機種,單顆GPU功耗達1,000W,HGX機種每台八顆GPU,NVL機種每櫃達36顆或72顆GPU,可觀能耗促進AI伺服器散熱液冷供應鏈成長。

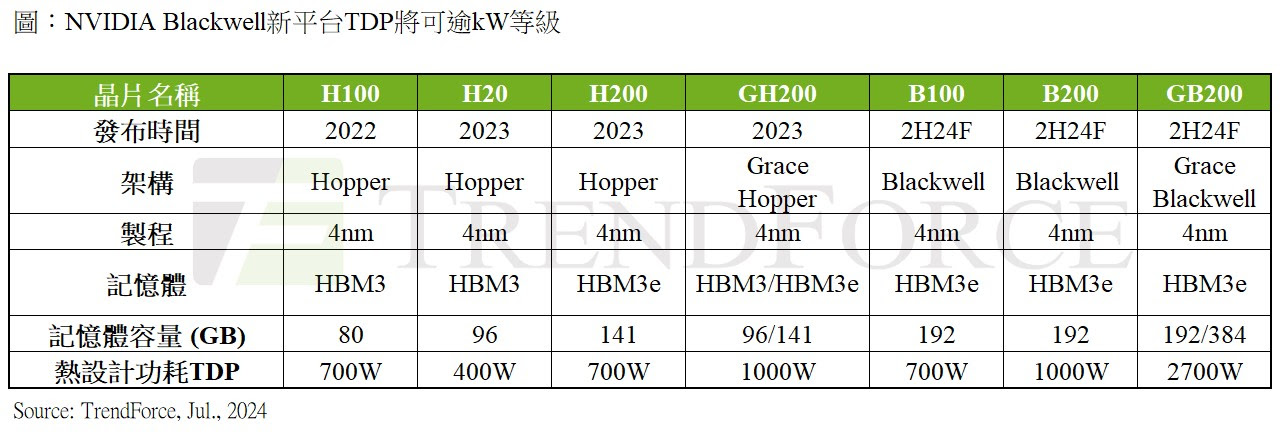

伺服器晶片熱設計功耗(Thermal Design Power,TDP)持續提高,如B200晶片TDP達1,000W,傳統氣冷散熱方案不足以應付需求;GB200 NVL36及NVL72整機櫃TDP甚至達70kW及近140kW,需搭配液冷方案方以有效解決散熱問題。

TrendForce了解,GB200 NVL36架構初期以氣冷、液冷並行方案為主;NVL72因有更高散熱需求,原則上優先採液冷方案。

觀察現行GB200機櫃系統液冷散熱供應鏈,可分水冷板(Cold Plate)、冷卻分配系統(Coolant Distribution Unit,CDU)、分歧管(Manifold)、快接頭(Quick Disconnect,QD)和風扇背門(Rear Door Heat Exchanger,RDHx)五大零組件。

CDU為關鍵系統, 負責調節冷卻劑流量至整個系統,確保機櫃溫度控制在預設TDP範圍。TrendForce觀察,目前NVIDIA AI方案以Vertiv為主力CDU供應商,奇鋐、雙鴻、台達電和CoolIT等持續測試驗證。

2025年GB200出貨量估達六萬櫃,使Blackwell平台成市場主流占NVIDIA高階GPU逾八成

2025年NVIDIA將以HGX、GB200 Rack及MGX等多元組態AI伺服器,分攻CSPs及企業型客戶,三機種出貨比例約5:4:1。HGX平台可較無痛接軌Hopper設計,CSPs或大型企業客戶可迅速採用。GB200整櫃AI伺服器方案將以超大型CSPs為主打,TrendForce預估NVIDIA年底先導入NVL36組態,以求快速進入市場。NVL72因AI伺服器整體設計及散熱系統較複雜,估2025年推出。

TrendForce表示,NVIDIA大力擴展CSPs客群,2025年GB200折算NVL36出貨量可望達六萬櫃,GB200的Blackwell GPU用量可達210萬至220萬顆。

然而終端客戶採GB200 Rack仍有幾項變數。TrendForce指NVL72需較完善液冷散熱方案,難度亦高,液冷機櫃設計較適合新建資料中心,但會牽涉土地建物規劃等複雜程序。且CSPs可能不希望受單一供應商綁規格,採HGX或MGX等搭載x86 CPU架構機種,或擴大自研ASIC AI伺服器基礎設施,以因應更低成本或特定AI應用。

(首圖來源:Created by Freepik)