在 2026 年巴塞隆納通訊展期間,在由 GSMA 主辦的 5G Futures Summit 上,GSMA 發布了《Gigauplink, Deterministic Latency, and Network Evolution for the Mobile AI Era》白皮書。白皮書定義了面向行動 AI 時代營運商原生語音業務的發展演進趨勢、應用場景和商業模式,並詳細闡述了 AI Calling 體驗評估規範,幫助營運商實現語音體驗建網計畫,助力使用者語音業務的體驗躍升。

白皮書指出,在 5G-A 與 AI 的協同驅動下,行動通訊進入到了行動 AI 時代,營運商的原生語音業務已從傳統語音演進到 AI 智慧語音。如今,在原生 IMS 語音網路基礎能力之上疊加 AI 演算法和算力,傳統的語音通話正在向增強型服務和創新應用演進,為使用者帶來穩定、高清、可視、智慧、高效的下一代通話體驗。這其中包括 AI 沉浸式通話、AI 互動式通話等應用方向,這些新的 AI 通話服務對網路連接能力和 AI 能力都提出了新的要求。

在白皮書中提到,AI 降噪是 AI 沉浸式通話中的典型應用,透過 AI 演算法消除不同場景下的環境噪音,使營運商的原生通話服務更加清晰,為使用者提供更加沉浸式的體驗。AI 降噪演算法可應用於辦公(> 40 分貝)、街道(> 60 分貝)和施工(> 80 分貝)等多種場景,使使用者無需依賴終端設備即可享受高品質的語音服務。AI 增強的即時翻譯是互動式通話的典型場景,得益於語音網路能力的增強,長期存在的語言障礙正在被打破。現在,透過 AI Calling 可以在視訊通話中提供準確即時的語音轉錄或翻譯,這對於參與國際線上會議的商務人士、前往異國旅行的遊客或聽力障礙人士來說,具有非常大的價值。

在商業模式方面,白皮書提到營運商可以透過嵌入 AI 能力,為傳統原生語音服務注入新功能與新活力。使用者透過支付訂閱費用,即可在標準通話中享受 AI 驅動的增強功能,使營運商從單一的流量變現轉向多維度的體驗變現。

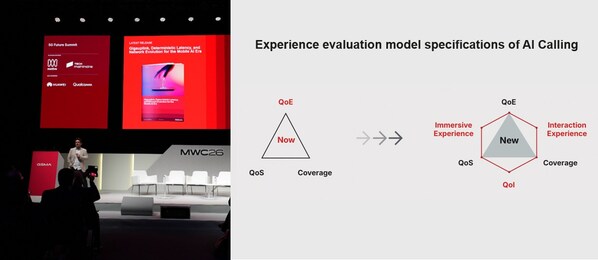

在 AI Calling 場景下,如何衡量使用者體驗是營運商面臨的新課題。這次白皮書系統性地定義了 AI Calling 的體驗評估模型規範。AI Calling 體驗評估模型規範在傳統高清語音三個體驗指標維度(QoE、QoS、涵蓋)的基礎上,疊加了 AI 沉浸式體驗、AI 互動式體驗、QoI 三個新的維度。其中,沉浸式通話場景可使基礎音通話體驗得到躍升,如可明顯感知的 MOS 提升、SNR 增強等。互動式通話場景下網路需要提供新的互動通道和能力,如透過 DC(Data Channel,資料通道)和 VC(Video Channel,視訊通道)能力,以實現螢幕共享、即時翻譯、客服座席互動等增強體驗。QoI 是衡量語音網路智慧化程度的關鍵指標,這包括高品質的 AI 模型、靈活的 AI 管理能力、基於 AI 的網路或使用者狀態感知與決策、普惠性 AI 服務能力等,是實現語音體驗躍升的網路基礎保障。

目前,ITU 已啟動一個名為 P.AI-MOS 的工作計畫,用於評估多模態人工智慧應用的使用者體驗,AI Calling 語音體驗的提案也在研究之中。基於此,GSMA 協同產業各界呼籲共同推動體驗評測發展,建立 AI 應用關鍵品質指標(KQI)與網路關鍵效能指標(KPI)之間的映射規則,加速行動 AI 業務體驗標準的落實,更好地支撐行動 AI 產業的發展。

(本文由 PR Newswire 授權轉載)