快速崛起的「代理 AI」(Agentic AI)需求,以及大型語言模型(LLM)對長上下文推理的嚴苛條件,輝達 2026 GTC 大會發表專為 AI 叢集設計的全新模組化儲存參考架構──BlueField-4 STX。這項被譽為「為代理 AI 打造最强大腦」的革命性技術,不僅重塑傳統資料中心的儲存堆疊,更在資料處理速度、處理量與能耗表現實現了前所未有的推進。

輝達說法,AI 技術演進,現代人工智慧已從單純的問答系統,進化為具備自主規劃、跨步驟執行與跨工具無縫交互能力的「代理 AI」。然而,這種進化也讓傳統資料中心面臨了巨大的挑戰。傳統的資料中心雖然能夠提供龐大容量的通用型儲存空間,但其架構設計卻缺乏快速回應的能力。當 AI 模型需要處理大量的上下文資訊時,傳統的儲存路徑會導致資料傳輸出現嚴重延遲,進而大幅拖慢 AI 的推理速度,並使得極為昂貴的 GPU 算力無法得到充分利用,導致 GPU 利用率大幅降低。

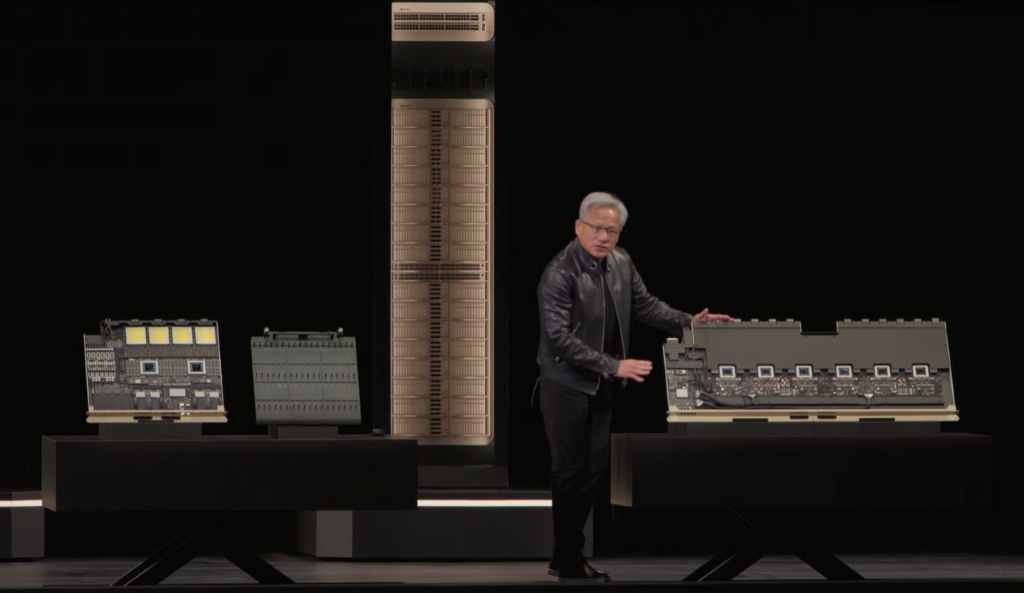

為了解決這項痛點,輝達執行長黃仁勳在 GTC 大會主題演講上強調,那些能夠在巨量上下文中進行推理並持續學習的 AI 系統,需要一種全新等級的儲存設備。他指出,NVIDIA STX 重新發明了儲存堆疊,為 AI 原生基礎設施提供了一個模組化的基礎,確保「AI 工廠」(AI factories)能夠始終保持在巔峰效能狀態下運作。STX 架構的核心設計理念在於讓儲存節點在物理與邏輯上更靠近運算資源,並達到規模化的資料存取,從而促使 AI 系統在推理、訓練與資料分析環節中,都能達到極高的吞吐量與極致的反應速度。

BlueField-4 STX 架構建立在輝達最新的 Vera Rubin 平台之上,其首要的硬體基礎是輝達於 2026 年 1 月甫發表的 BlueField-4 資料處理單元(DPU)。這款專為儲存最佳化的處理器內部整合了 Vera CPU 與 ConnectX-9 超級網卡(SuperNICs),並協同 Spectrum-X 乙太網路交換器,以及 DOCA 和 AI Enterprise 軟體共同運作。

在傳統的基礎設施架構中,伺服器從儲存設備讀取或擷取資料時,資料流必須經過中央處理器(CPU)與作業系統,這些「中繼站」無形中增加了龐大的延遲。而 BlueField-4 STX 透過 Spectrum-X 與 ConnectX-9 支援的 RDMA(遠端直接記憶體存取)技術,讓資料能夠完全繞過 CPU 與作業系統的干預,直接在 GPU 與快閃記憶體之間進行高速傳輸。DPU 的核心價值在於完美卸載了伺服器主處理器處理基礎設施管理(如管理 GPU 與快閃記憶體間的資料流量)的任務,將更多寶貴的運算能力保留給 AI 應用程式本身。

受惠於硬體架構的全面最佳化,BlueField-4 STX 展現了令人矚目的效能升級。輝達官方指出,與早期的儲存架構相比,BlueField-4 STX 在處理 AI 模型的資料單位(Tokens)時,速度提升了高達 5 倍。此外,在能源消耗日益成為資料中心重擔的今日,該架構的能效比傳統 CPU 架構大幅提升了 4 倍。而在處理企業級 AI 資料時,其資料攝取速度(即每秒頁面處理量)更是直接翻倍,為企業級應用提供了強大的後盾。

為落實這項架構,輝達推出了 BlueField-4 STX 的首個機架級部署設計方案,也就是CMX 上下文記憶體儲存平台(Context Memory Storage platform)。CMX 專為儲存大型語言模型所高度依賴的「鍵值快取」(Key-Value caches,簡稱 KV cache)而設計。這架構在大型語言模型的運作機制中,其「注意力機制」(Attention mechanism)會分析輸入提示(prompt)中的每一個元素,判斷哪些元素最為重要並排定優先順序。在此過程中,內容會被轉換為數學向量物件,主要分為幫助模型尋找資訊的「鍵(Keys)」與實際保存資訊的「值(Values)」。CMX 透過高速快閃記憶體來儲存 AI 叢集的 KV 快取,並利用 BlueField-4 晶片將這些關鍵資料的管理任務從主機叢集的 CPU 中下放,透過高效能上下文層大幅擴展了 GPU 的記憶體容量,從而顯著提升整體效能。

CMX 平台的另一項重大創新在於其針對 AI 工作執行特性的「減法哲學」。傳統的儲存系統為了降低資料遺失的風險,通常會強制運行多種耗費硬體資源的保護演算法。然而,輝達深刻理解到,KV 快取中的資訊與標準的商業機密紀錄不同,它通常只需要保留極短的時間就會被刪除,且即使遺失也相對容易重新生成與恢復,不需要同等級的資料遺失保護機制。因此,CMX 系統選擇不在其保存的 KV 快取上執行這些繁重的資料遺失保護演算法,此一舉措成功避免了相關的硬體資源開銷(Overhead),進一步釋放了系統潛能並加速了 AI 叢集的工作運行。

BlueField-4 STX 的問世已經在業界引發了強烈迴響與廣泛支持。輝達透露,目前已有超過半打(六家以上)的重量級客戶計畫採用此項新技術,其中包含甲骨文公司(Oracle Corp. / OCI)、知名 AI 新創 Mistral AI 以及雲端運算供應商 CoreWeave 都是首批核心採用者。同時,戴爾(Dell)、惠普企業(HPE)以及 IBM 等全球頂級的儲存設備供應商,目前也正積極基於 STX 架構,與輝達聯合設計下一代的 AI 基礎設施。輝達預期,合作夥伴將於 2026 年下半年正式向市場交貨採用 BlueField-4 STX 平台的儲存系統。

隨著 AI 模型規模與複雜度的指數級成長,單純的算力提升已不足以應付未來的產業需求。輝達透過 BlueField-4 STX 儲存架構的發布,再次證明了其不僅是 GPU 領域的霸主,更是在整體系統架構與 AI 資料中心基礎設施上,持續引領著全球科技產業邁向「代理 AI」發展的新紀元。

(首圖來源:視訊截圖)