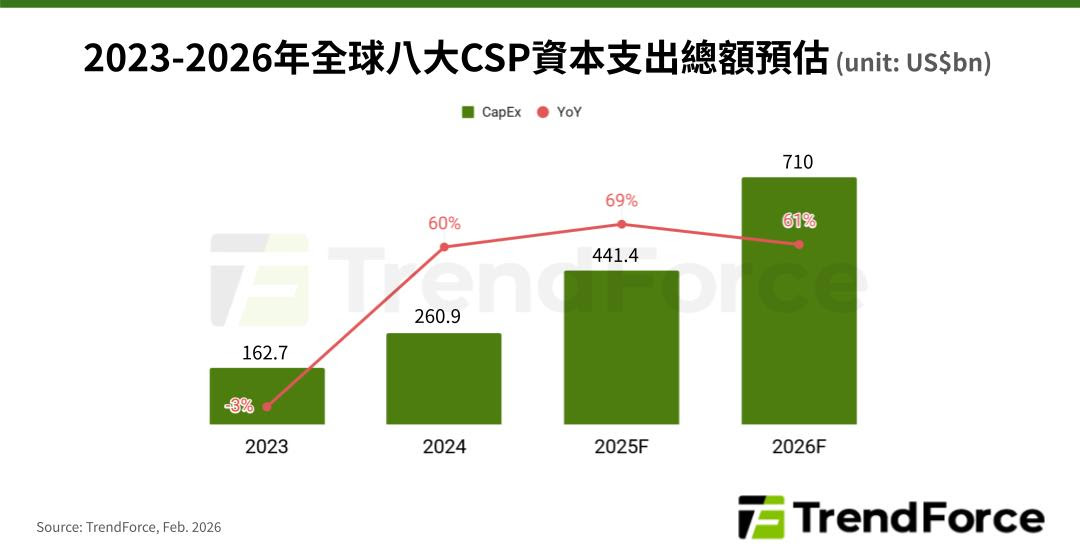

TrendForce 最新 AI 伺服器產業研究,為加速 AI 應用導入與升級,全球雲端服務供應商(CSP)持續加強投資 AI 伺服器及相關基礎建設,2026 年八大主要 CSP 合計資本支出將超過 7,100 億美元,年增率約 61%。業者除持續採購 NVIDIA、AMD GPU 方案,也擴大導入 ASIC 基礎設施,以確保各項 AI 應用服務適切性,以及資料中心建置成本效益。

八大CSP為美系Google、AWS、Meta、微軟、甲骨文及中系騰訊、阿里巴巴、百度。TrendForce預估,今年Google母公司Alphabet資本支出有望逾1,783億美元,年增高達95%。Google較其他CSP更早投入自研ASIC,已累積相當研發優勢,今年TPU主力將轉進至v8新平台。受惠Google Cloud Platform、Gemini等AI應用帶動TPU需求,2026年TPU於Google AI伺服器出貨占比將上升至近78%,擴大與GPU AI伺服器差距。Google也是各CSP唯一ASIC機種出貨比例高於GPU機種的業者。

亞馬遜近期則上調NVIDIA GB300、V200整櫃系統採購規模,反映加速導入更高功耗與密度的GPU平台,以因應雲端AI訓練、推理服務擴張,2026年GPU機種於自家AI伺服器占比將達近60%。自研ASIC部分,新Trainium 3將於第二季起接續Trainium 2 / 2.5放量,系統端因尚需配合軟體成熟度、產品驗證等,出貨動能可能到下半年才較顯著。

TrendForce估2026年Meta資本支出將破1,245億美元,年增77%。AI伺服器也以NVIDIA、AMD方案為主,GPU機種占比仍將高達80%;另欲推進自研ASIC,以降低單位算力成本、分散對單一供應商的依賴,惟據供應鏈評估,MTIA仍受軟硬體系統調教耗時等影響,恐面臨實際出貨不如預期的風險。

微軟看好大模型訓練推理的長期需求,主要購置NVIDIA整櫃解決方案支持AI伺服器出貨。日前發表自研晶片Maia 200,鎖定高效率AI推理應用。甲骨文則因應Stargate、OpenAI等擴增AI資料中心專案,持續佈建GPU整櫃式方案。

分析中系CSP動態,儘管字節跳動未公開揭露2026年資本支出細節,TrendForce估一半以上資金將採購AI晶片相關。NVIDIA H200可望成為其AI伺服器的主要方案,但仍須視後續美國、中國審查狀況而定。字節跳動同時擴大導入本土AI晶片,主要採Cambricon等方案。

騰訊外購NVIDIA等GPU方案支撐雲端、生成式AI需求,也同時與本土業者合作發展ASIC自主方案,聚焦網通應用、資料中心基礎架構、線上AI應用服務等場景,以分散算力來源並提升系統整合彈性。

阿里巴巴和百度皆積極自研ASIC AI晶片。阿里巴巴旗下有平頭哥、阿里雲事業等,提供公有雲和其他線上服務的AI應用基礎設施,並開發千問(通義)LLM及App應用軟體等,同時針對自用雲端、 企業和消費性用戶。百度2026年後陸續導入昆侖新方案, 鎖定大規模AI訓練或AI推理應用,並嘗試發展AI伺服器cluster超節點天池系列,連結可達數百顆AI晶片以強化整體AI系統運算能力。

(首圖來源:AI)