在 2026 年 GTC 大會上,輝達(NVIDIA)創辦人暨執行長黃仁勳正式發布為推動「代理型 AI(Agentic AI)」而生的全新一代 Vera Rubin AI 平台。黃仁勳強調,Vera Rubin 是一次真正的「代際飛躍」,這不僅標誌著輝達史上最大規模基礎設施建設的開端,更代表其技術版圖已全面覆蓋從大規模預訓練到即時智能體推論的 AI 全生命週期。透過這項革命性架構,單 Token 成本將大幅降至上一代的十分之一,宣告全球 AI 算力進入全新的經濟學紀元。

Vera Rubin 平台顛覆性硬體架構與極致效能

顛覆性硬體架構與極致效能黃仁勳指出,隨著大型語言模型(LLM)的參數規模不斷膨脹,模型需要更快地生成 Token 以進行思考,同時還要頻繁存取記憶體與儲存系統,甚至需要運用外部工具(如網頁瀏覽器或雲端虛擬 PC)。為了滿足代理型 AI 系統對超低延遲與極致效能的嚴苛需求,輝達打造了 Vera Rubin 平台,將軟硬體進行了端到端的全面垂直整合。

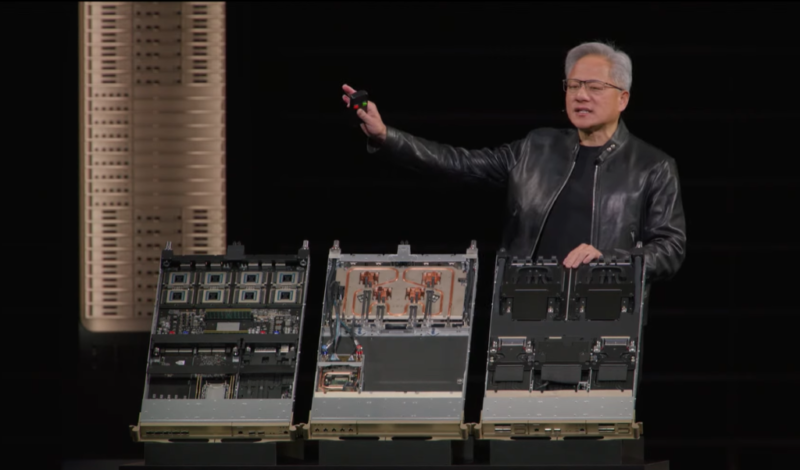

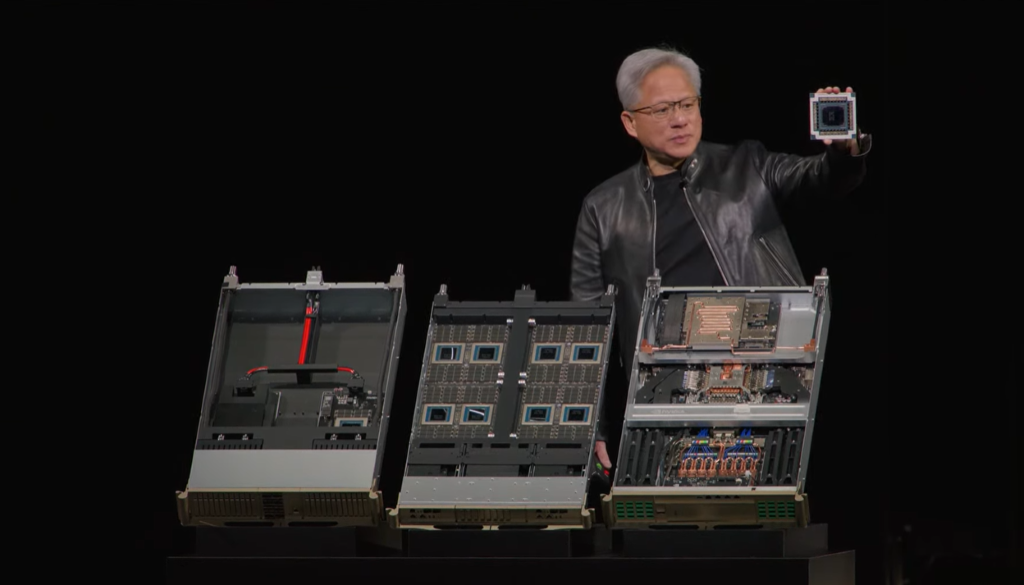

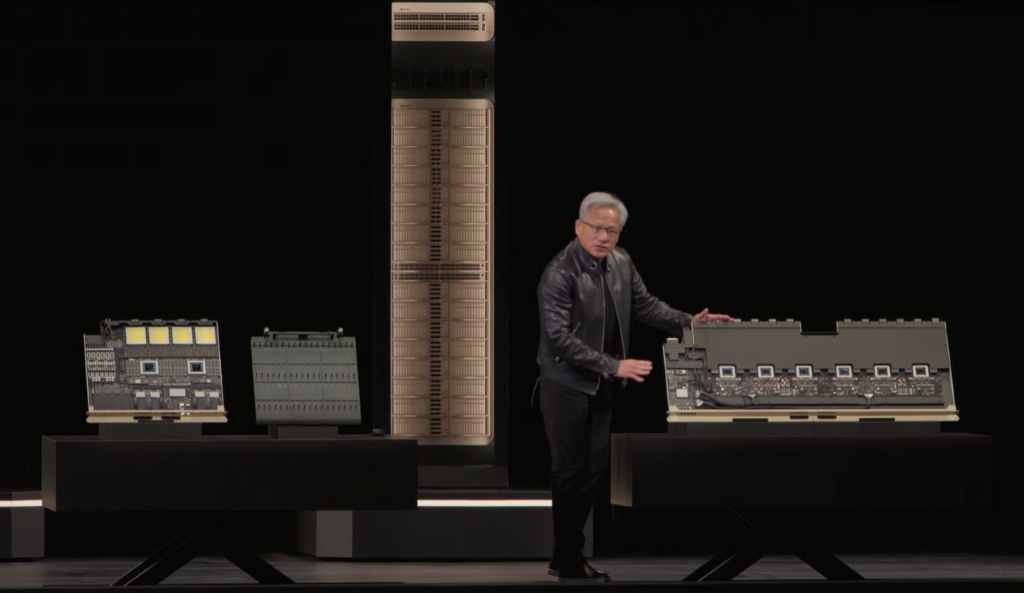

與上一代 Blackwell 平台相比,Vera Rubin 展現了驚人的效能躍進。該系統僅需四分之一的 GPU 即可完成混合專家大模型(MoE)的訓練,且每瓦推論吞吐量飆升高達 10 倍,成功將單 Token 的生成成本降至十分之一。在基礎設施配置上,新一代的 NVL72 機架透過第六代 NVLink 連接了 72 塊 Rubin GPU 與 36 塊 Vera CPU。黃仁勳特別指出,第六代 NVLink 交換系統是極度難以實現的技術,但輝達成功達成了這項創舉。

此外,Vera Rubin 系統採用 100% 水冷設計,使用 45°C 的溫水進行冷卻,徹底移除了傳統繁雜的纜線,這不僅大幅減輕了資料中心的冷卻壓力與能源成本,更將過去需要花費兩天才能完成的安裝時間,驚人地縮短至僅需兩小時。

Vera CPU 強勢登場,力拼英特爾與 AMD的CPU市場

本次大會的另一大亮點,就是輝達首度展現其在中央處理器(CPU)領域的強大野心。Vera CPU 的發布標誌著輝達正式跨入傳統 CPU 賽道,這不僅直接與英特爾、AMD 展開正面交鋒,更向全球雲端運算巨頭自研的 Arm 架構處理器發起強烈挑戰。黃仁勳透露,Vera CPU 的獨立銷售情況極佳,將成為輝達旗下一個達數十億美元規模的龐大業務。

為了應對 AI 使用工具時所需的極速反應,Vera CPU 專為極高的單執行緒效能、強大的資料處理能力與極致的能源效率而設計。單顆 Vera 晶片配備了 88 個核心與 144 個執行緒,採用輝達深度客製化的 Arm v9.2-A Olympus 核心,其指令級平行度(IPC)實現了 1.5 倍的代際提升。更具革命性的是,該架構首發引入了「空間多執行緒(Spatial Multithreading)」黑科技,透過實體隔離流水線組件,讓多個執行緒能真正在單核上同時運行,徹底消除了傳統多執行緒技術因資源排隊而造成的算力損耗。

Vera CPU 也是全球首款採用 LPDDR5 記憶體的資料中心 CPU,提供無與倫比的單執行緒效能與每瓦效能。專為驗證 AI 模型結果設計的 Vera CPU 機架更整合了 256 塊水冷 CPU,運行效率達到傳統 CPU 的兩倍,速度提升 50%。

併購效應爆發,結合 Groq LPU推論處理量暴增 35 倍

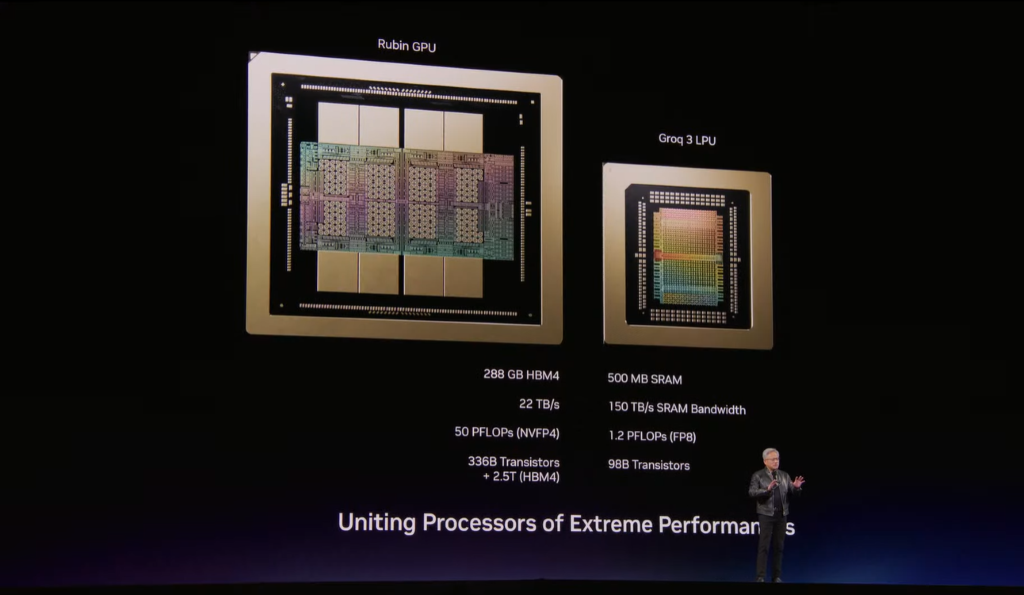

黃仁勳指出,代理型系統面臨的最大挑戰在於高處理量與低延遲往往是互相衝突的。為了突破這個物理限制,輝達整合了先前收購的 Groq 團隊技術,推出了包含 256 個 LPU(語言處理單元)的 Groq 3 LPX 推論加速機架。這款被命名為 LP30 的第三代晶片由三星代工製造,目前已進入量產階段,預計於2026年第三季出貨。

黃仁勳解釋,Groq 的架構是專為推論設計的確定性資料流處理器,擁有高達 500MB 的 SRAM,且完全由編譯器進行靜態排程。輝達提出了一個被稱為「解耦合推論(Disaggregated Inference)」的概念,並透過名為 Dynamo 的 AI 工廠作業系統進行無縫整合。

在這種架構下,需要大量數學運算與乘載龐大 KV Cache 的預填充(Prefill)與注意力機制(Attention)交由具備 288GB 記憶體的 Vera Rubin 處理。而受限於頻寬與延遲的解碼(Decode)及 Token 生成任務,則卸載給 Groq LPU。兩者透過延遲減半的特殊乙太網路模式緊密耦合,最終使每百萬瓦推論吞吐量最高飆升至 35 倍。

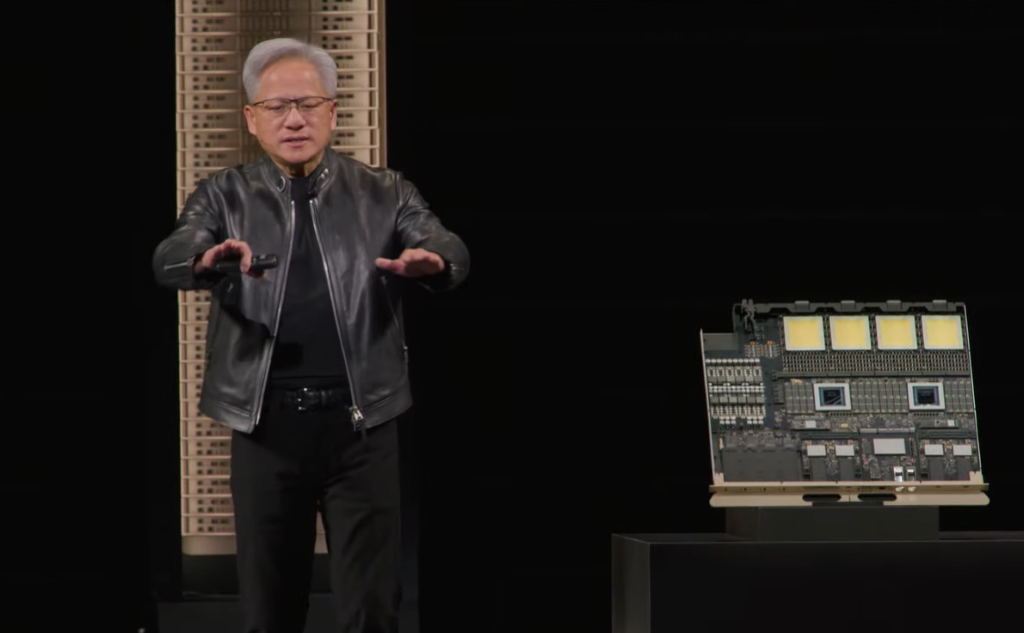

重塑網路與 AI 原生儲存架構

在網路連接與叢集擴展方面,輝達展示了全新一代的 Kyber 機架,這是一款專為 Rubin Ultra 運算節點設計的系統。有別於傳統的水平插拔,Kyber 採用垂直插入設計,透過背板的中板(Midplane)連接,成功在單一 NVLink 網域內連接多達 144 個 GPU,突破了傳統銅纜連接的距離限制。同時,輝達也與台積電(TSMC)合作,獨家量產名為COUPE的革命性共同封裝光學(CPO)技術,並應用於全球首款 CPO Spectrum-X 交換器中,讓光學訊號直接與晶片對接。

在資料儲存層面,針對 AI 頻繁存取 KV Cache、結構化與非結構化資料所帶來的巨大壓力,輝達推出了全新 BlueField-4 STX 機架。這套 AI 原生儲存基礎架構結合了 CX9 網卡與 Vera CPU,並藉助全新的 DOCA Memos 框架,能高效處理大型語言模型生成的海量 KV 快取資料,在大幅降低能耗的同時,將推論處理量最高提升 5 倍,完美支援更快速的 AI 多輪互動。黃仁勳自信地表示,全球 100% 的儲存產業都將加入這套系統的生態圈。

AI 工廠經濟學與未來藍圖

黃仁勳在演講中提出了一個極具觀察力的商業模型,就是表示未來Token 將成為全新的大宗商品(Commodity)。AI 服務將根據處理量、生成速度與上下文長度劃分為免費層、中階層、高階層與尊榮層(Premium)。透過 Vera Rubin平台極致的效能提升,資料中心營運商在相同的電力預算(如 1GW)下,其創造的營收將是 Blackwell 時代的 5 倍。目前的生產線已具備每週製造 1000 套系統的能力,將迅速推動全球多個十億瓦級(Multi-Gigawatt)AI 工廠的建置。微軟 Azure 更已率先上線了首批 Vera Rubin 機架。

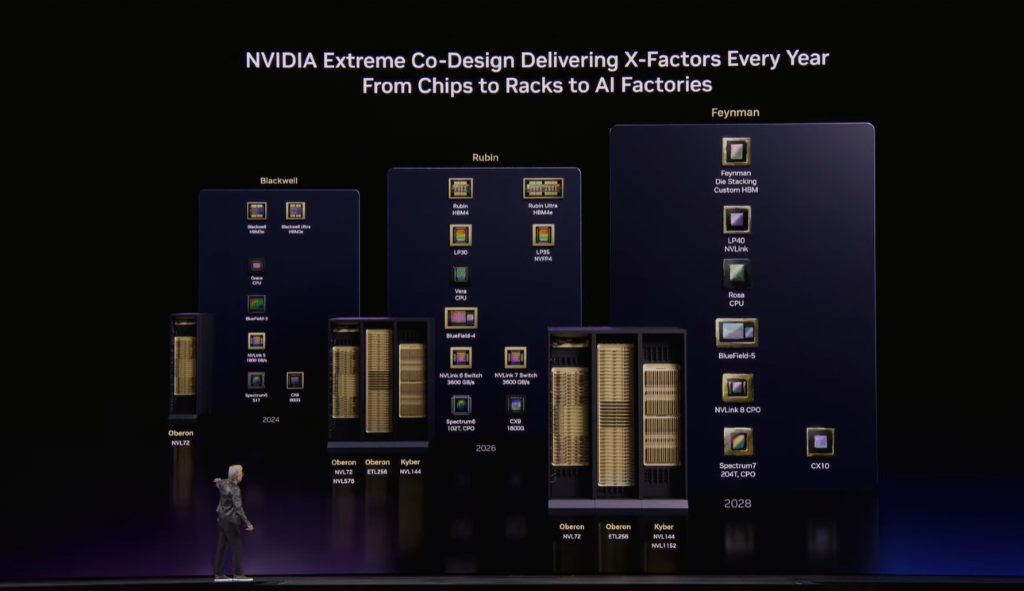

放眼未來,輝達的創新步伐並未停歇。黃仁勳也揭露了最新的技術藍圖,包含支援光學與銅纜擴展至 576 塊 GPU 的 Oberon 系統、首度導入 NVFP4 運算結構的 LP35 晶片,以及下一代代號為「Feynman」的全新架構。

未來,Feynman平台將配備全新的 LP40 LPU、名為 Rosa(Roslin)的新一代 CPU、BlueField 5 以及超級網卡 CX10,全面支援銅纜與 CPO 光學的垂直橫向擴充。將從單一晶片的極限突破,到資料中心級距的宏觀設計。而Vera Rubin 平台的問世,不僅確立了輝達在 AI 基礎設施領域不可撼動的霸主地位,更為全球產業界描繪了一幅由代理型 AI 驅動的全新智慧未來。

(首圖來源:視訊截圖)